本文来自智东西(zhidx.com),作者 | 徐豫。

DeepSeek-R1横空出世,打响了大模型比拼性价比的第一枪。

Meta、OpenAI等国外头部大模型厂商纷纷复刻或变相降价。比DeepSeek-R1晚两周发布的OpenAI o3-mini模型,定价比前代模型o1-mini降低了超6成,比前代完整版的o1模型便宜超9成。

国内的大模型厂商也迅速做出反应。2月13日,百度宣布文心一言将于4月1日全面免费开放。文心一言此前采取基础版免费、专业版收费的模式,专业版定价59.9元/月,连续包月优惠价49.9元/月。

这场看似仅仅是价格层面的竞争,实则背后蕴含着更为深层次的较量,其不仅是技术实力的比拼,也是对用户市场的争夺。

在这场没有硝烟的商战中,中国算力市场正经历着深刻的变革。

最近发布的《2025年中国人工智能计算力发展评估报告》(以下简称《报告》),把中国算力发展的四大变化,从“幕后”搬到了“台前”。

▲中国AI应用场景发展(图源:IDC 2025)

一、算力效率之变:大模型从“大力出奇迹”,转向“四两拨千斤”

第一大变化体现在算力效率方面,DeepSeek通过算法优化,大幅降低大模型训练、推理对高端GPU的依赖,突破了“算力军备竞赛”的传统路径。

模算效率的显著提升,正是DeepSeek能够实现高性价比的核心因素之一。

DeepSeek的论文显示,DeepSeek-R1训练成本仅557万美元,不足OpenAI同类产品的5%,却能在数学竞赛、代码生成等任务中超越GPT-4模型。这意味着DeepSeek-R1以较低的算力成本投入,也能实现高性能产出,即模算效率较高。

这其中的模算效率(Model Computation Efficiency)就是,AI模型的训练和推理过程中用来衡量模型精度与计算资源利用效率的综合指标,它反映了模型在特定硬件平台上,以最小的算力消耗实现最高精度的能力。

DeepSeek“四两拨千斤”的研发模式,更加注重算法创新、架构优化和资源的高效利用,这或许将带动业界对于模算效率的追求。IDC中国副总裁周震刚接受采访时称,未来,大模型厂商们的关注点将从追求参数量规模,转变为追求模型训练、推理、部署等环节的性价比。

此外,DeepSeek使用MoE(混合专家模型)架构实现了更高的成本效益,而Dense架构在相同参数量下扩展的计算成本较高。浪潮信息高级副总裁刘军在接受采访时回顾:“去年开始,大家发现基于Dense架构的模型,再往前去演化到要训练一个超过五千亿、一万亿参数量的模型时,所需的算力、时间、数据量,都是当前技术条件下实现不了的。有企业做过一个评估,在这种情况下,需要20万张卡训练一年,才能把一个万亿的Dense模型高质量训练出来。”

因此,MoE展现出来的在计算成本、模型性能等方面的优势,或将引发业界对于该架构的一波模仿借鉴。

当下,企业接入DeepSeek模型主要有两种策略。一方面,国内大模型厂商、芯片厂商、AI硬件厂商、运营商、AI应用开发商等相继接入DeepSeek模型671B满血版;另一方面,有的企业会根据自身业务需求选择接入DeepSeek参数量较小的模型,或者选择蒸馏DeepSeek模型将其与自家模型相结合,从而提高模型性能、降低应用成本。

这种多形态、多参数的模型协同发展,才是大模型生态应有的状态。在浪潮信息高级副总裁刘军看来,把DeepSeek-R1模型的能力蒸馏到一些小模型上,实际会促进AI技术的扩散。

二、算力结构之变:智能算力市场井喷,推理算力成“香饽饽”

将目光放到整个算力市场,我们可以发现第二大变化,国内智能算力规模正极速扩张,需求结构也正被重塑。

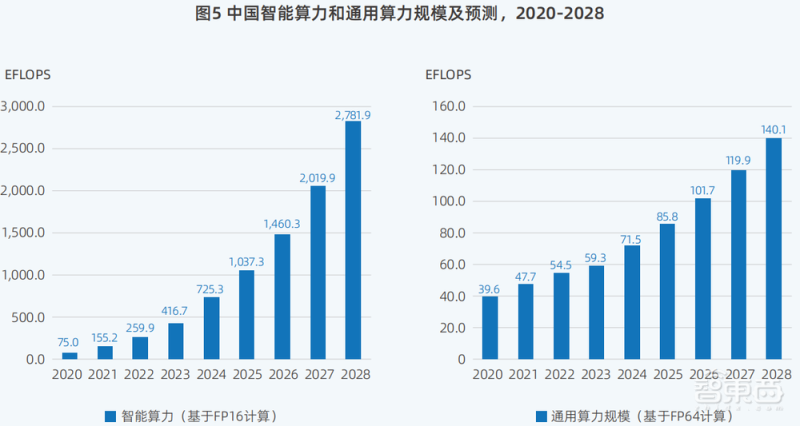

《报告》显示,2024年中国智能算力规模达725.3EFLOPS,同比增长74.1%,是近5年来的总量最高峰。这也是近年来中国智能算力规模扩张速度最快的一次。

相比于国内通用算力,智能算力的增幅已经达到同期通用算力增幅的3倍以上。2024年中国通用算力规模为71.5EFLOPS,同比增长20.6%。

▲2020年至2028年,中国智能算力和通用算力规模及预测(图源:IDC 2025)

这意味着,过去一年内,AI芯片、AI服务器、AI训练、AI推理和AI应用的市场规模也在快速膨胀。例如,2024年中国AI加速计算服务器市场规模为190亿美元,同比大幅增长86.9%。

尽管此前业界对大模型的Scaling law(规模法则)是否失效有所争议,但在当下的AI发展进程中,其仍占主导地位。这也是推动AI算力需求持续增长的主要原因之一。

《报告》中提到,基于杰文斯悖论的现象反映出,DeepSeek实现的算法效率提升,并未抑制算力需求,反而带动了更多的用户和场景,进一步推动了大模型的普及与应用落地。这也有助于AI行业重构产业创新范式,并加强数据中心、边缘及端侧算力建设。

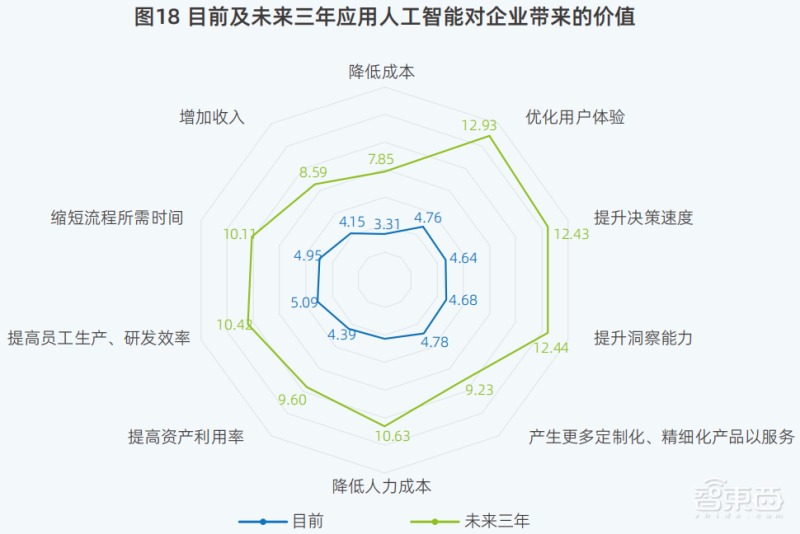

▲目前及未来三年应用AI对企业带来的价值(图源:IDC 2025)

不过,单单堆叠训练算力的策略并不能一劳永逸。越来越多大模型厂商转向加速开发大模型的多模态能力,并寻找落地场景。多模态模型的应用、AI Agent热潮随之出现,并且知识管理、对话式应用、内容生成、营销、视频生成等都成为了生成式AI技术的热门落地场景。

在应用落地侧,这会大幅激发AI推理需求。

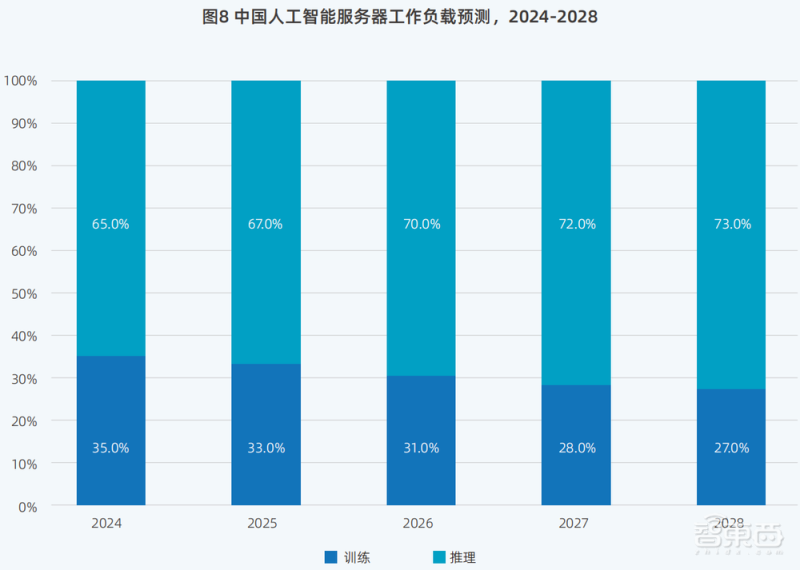

如聊天机器人、音视频图像等的生成、办公场景的AI助手等,在实际的应用场景中都较为依赖AI推理能力。因此,《报告》中预测,后续用于推理的算力规模,将会超过用于训练的算力规模。

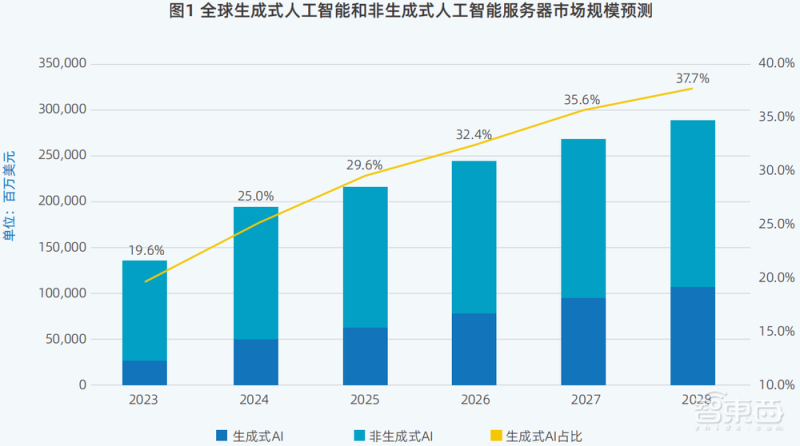

在全球AI服务器市场中,未来生成式AI服务器的占比,将从2025年的29.6%,提升至2028年的37.7%。

▲2023年至2028年,全球生成式AI和非生成式AI服务器市场规模预测(图源:IDC 2025)

在真实的业务场景中实现“降本增效”是AI技术发展的重要一环。未来,随着大模型相关技术逐渐成熟,以及生成式AI应用不断拓展,推理场景的需求日益增加,推理服务器的占比将大幅提高。IDC的数据显示,预计到2028年,推理工作负载占比将会达到73%。

▲2024年至2028年,中国AI服务器工作负载预测(图源:IDC 2025)

这一发展趋势也在浪潮信息的业务中得到了印证。据浪潮信息高级副总裁刘军透露,近期公司接到的大部分都是推理算力的订单,现阶段推理算力的投资回报率高,带来的用户体验也更好,所以推理算力的规模会大幅提升。

三、算力供应方式之变:算力供应方式多元化,企业AI选择更多了

第三大变化来自算力供应的方式。蛋糕做大了,下场分蛋糕的人也多了。

去年有一大很明显的市场趋势是,一方面,AI算力基础设施的供给结构趋于多元化,另一方面,用户对智能算力基础设施和服务能力的需求,也在发生深刻变化。

在供给端,其形成了数据中心服务商、云服务商、硬件厂商和相关AI创企多点提供AI算力资源的格局。

在需求端的变化则集中于两点:

首先,生成式AI将进一步推动企业,使用AI就绪的数据中心托管设施、生成式AI服务器集群等智算服务,这可以帮助企业缩短部署时间,降低资本成本。

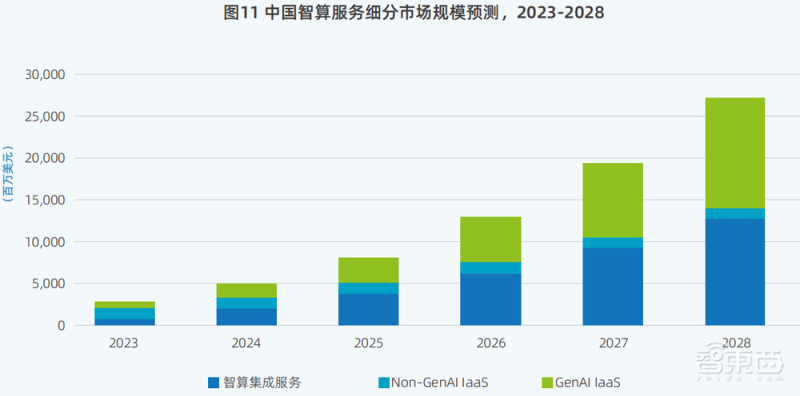

IDC数据显示,2024年中国智算服务市场整体规模达到50亿美元;其预计2025年中国智算服务市场整体规模将达到79.5亿美元,2028年达到266.9亿美元,2023年至2028年的年复合增长率将达到57.3%。

▲2023年至2028年,中国智算服务细分市场规模预测(图源:IDC 2025)

其次,用于推理的一体机也开始受到市场追捧。

IDC中国副总裁周震刚解释说,早前企业基于云服务部署AI的案例比较多,而用一体机的比较少。但是DeepSeek模型爆火后,企业对于一体机的需求随之大幅上升,开始注重私有化部署。

因此,后续一段时间内,“开源+一体机”可能会成为企业AI服务的爆款模式。

据不完全统计,目前市面上至少已有60家DeepSeek一体机企业,其中既有京东云、移动云、联通云等云服务提供商,也有联想、华为等大厂。基于一体机,企业便可以通过“开箱即用”的方式,快速接入更强大的AI能力。

浪潮信息上周推出的元脑R1推理服务器,就是其中一员。浪潮信息方面称,该产品通过系统创新和软硬协同优化,单机即可部署运行DeepSeek-R1满血版671B的模型。

据浪潮信息高级副总裁刘军透露,“最近两个礼拜,来找我们咨询购买能带动满血版DeepSeek-R1模型的AI服务器的客户数,正直线上升。”

四、城市AI排名之变:京杭沪拿下AI算力全国前三

第四大变化是城市AI算力排名。

《报告》的数据显示,目前国内各城市正通过加大AI投资、吸纳人才以及提供政策支持等举措,持续为AI发展提升竞争优势。

可以看到,在中国各城市的AI算力排行榜中,北京和杭州依然稳居排行榜前两位,上海的排名则从2023年的第四位上升至第三位。

这3座城市的AI策略各有所侧重。其中,北京聚集了一大批大模型企业,凭借大量人才、成熟的企业和有力的政策扶持,持续位居首位。杭州早在2021年就提出要成为具有全球影响力的AI头雁城市,并颁布了诸多政策支持AI发展;上海的优势在于,其正加速推动AI世界级产业集群建设等工作,并表现出色。

此外,广州、成都、天津、厦门等城市的AI算力全国排名均有所提升。

▲中国各城市AI计算力发展评估TOP 10(图源:IDC 2025)

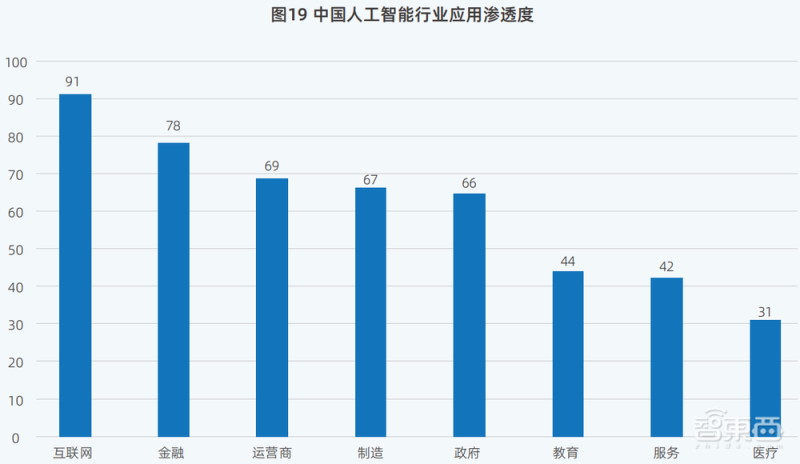

AI影响下,不同行业的AI应用渗透度排名也发生了变化。

排名第一的是互联网行业,其AI相关应用的渗透率更高。在该行业中,AI原生应用已覆盖问答、写作、客服、路线规划、生活指导、学习助手、角色扮演、视频生产、图片企业智能客服、智能销售分析等多个场景。

金融行业从2023年的第四名,上升至2024年的第二名。制造行业2024年的排名相较于2023年前进了一位。这是由于金融行业积累了海量的数据,可以用于AI训练,为其进行风险评估等提供决策依据;在制造业方面,由AI驱动的机器人和自动化设备可以完成重复性高、劳动强度大的工作任务。

▲中国AI行业应用渗透度(图源:IDC 2025)

结语:未来算力发展既要“扩容”,也要“提效”

从这四大变化可以看出,国内算力产业的发展正呈现出蓬勃向上的态势。与此同时,更为迫切的算力发展挑战也被摆到了算力提供商面前。未来,如何持续优化计算架构,如何进一步提升智算中心的算力资源利用率,如何完善数据中心的监控系统和故障恢复机制,都亟需新的解决方案。

针对此,《报告》也提出了解决办法,那就是算力提供商可以根据自身情况,采用算力“扩容”和“提效”并行策略来部署AI算力。

其中,扩容包括增加智算中心的数量和种类,注重智算中心建设的区域分布和技术先进性,以加强算力供给能力。

提效包括以用定建,以应用为导向规划AI基础设施;提高模型架构效率;优化算力基础设施架构,包括计算架构、内存层次架构、智能调度算法等;使用高质量的数据集,并搭建统一的数据存储和访问接口,以提高算力利用率。

未来,大模型产业的底层技术创新加速、场景应用逐渐铺开,都将为国内算力市场注入新活力。