本文来自微信公众号“半导体产业纵横”。

有多少钱会花在AI芯片上?

众所周知,企业,尤其是超大规模企业和云计算构建商,都希望可以利用生成式人工智能,目前他们正在花费巨资购买人工智能加速器和相关芯片,以创建人工智能训练和推理集群。

不过,你想要试着算一算到底花了多少钱却很困难。因为很难划清人工智能芯片与构成系统的周边设备之间的界限。估算人工智能市场规模的部分问题在于,没有人真正知道服务器在制造和销售之后会发生什么,以及它被用来做什么。举例来说,你怎么知道一台装载了GPU的机器到底做了多少AI工作或HPC工作?

早在12月份假期结束时,笔者就深入研究了IDC的GenAI支出预测,该预测非常吸引人,因为它将GenAI工作负载与其他类型的AI区分开来,并讨论了构建GenAI系统所需的硬件、软件和服务支出。当然,笔者也提到了AMD首席执行官苏姿丰在2022年和2023年就各类数据中心人工智能加速器(包括GPU和所有其他芯片)提出的最初和修订后的总目标市场。

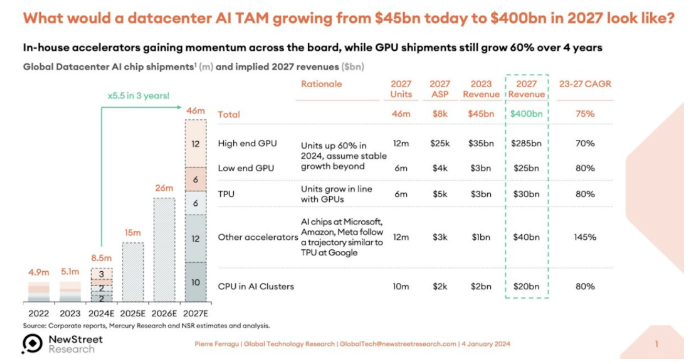

要提醒大家的是,苏姿丰表示,数据中心AI加速器的目标市场总额在2023年约为300亿美元,到2027年底将以约50%的复合年增长率增长到1500亿美元以上。但一年后,随着12月"Antares"Instinct MI300系列GPU的发布,GenAI热潮骤然升温,苏姿丰表示,AMD预计2023年数据中心AI加速器的市场规模为450亿美元,到2027年将以超过70%的复合年增长率增长,达到4000亿美元以上。

这还仅仅是加速器,而不是服务器、交换机、存储和软件。New Street Research的Pierre Ferragu团队在科技领域做了很多工作,他们在推特上发布了一份关于4000亿美元数据中心加速器TAM可能如何细分的报告。

这是一个非常大的数字,它假定在TAM预测期结束时,人工智能服务器、存储和交换机的销售额约为1万亿美元。

从2024年开始,笔者从富国银行股票研究公司(Wells Fargo Equity Research)董事总经理兼技术分析师亚伦-瑞克斯(Aaron Rakers)那里获得了GPU的销售预测,并在电子表格中找到了一些乐趣。该模型涵盖了从2015年到2022年的数据中心GPU销售情况,并对2023年(预测时数据中心GPU销售尚未结束)和2027年进行了预测。富国银行的预测模型也早于AMD最近几个月做出的修订预测,AMD称2024年GPU销售收入将达到40亿美元。

无论如何,富国银行的模型显示,2023年GPU的销售额为373亿美元,全年出货量为549万台。出货量几乎翻了一番,其中包括各种GPU,而不仅仅是高端GPU。GPU收入增长了3.7倍。根据预测,2024年的数据中心GPU出货量将达到685万块,同比增长24.9%,收入将达到487亿美元,同比增长28%。根据预测,2027年的GPU出货量将达到1351万个,数据中心GPU销售额将达到953亿美元。在这个模型中,英伟达在2023年的收入市场份额为98%,到2027年才下降到87%。

最近,Gartner和IDC都发布了一些关于人工智能半导体销售的统计和预测,我们不妨对它们进行一下了解,以便尝试估计一下人工智能芯片市场的现状,以及若干年后可能出现的情况。

从Gartner开始。将近一年前,Gartner发布了一份关于2022年人工智能半导体销售额的市场研究报告,并对2023年和2027年的销售额进行了预测;几周前,Gartner又发布了一份修订版预测报告,对2023年的销售额进行了预测,并对2024年和2028年的销售额进行了预测。第二份报告的市场研究还包含一些统计数据,这里将其添加到下表中。

Gartner公司副总裁兼分析师Alan Priestly表示,到2026年,所有售出的个人电脑芯片都将是人工智能个人电脑芯片,因为所有笔记本电脑和台式机CPU都将包含某种神经网络处理器。

用于加速服务器的AI芯片是关注的重点,这些芯片的收入(假设不包括其所附带的HBM、GDDR或DDR内存的价值)在2023年为140亿美元,预计在2024年将增长50%,达到210亿美元。但在2024年至2028年期间,服务器用人工智能加速器的复合年增长率预计仅为12%左右,销售额将达到328亿美元。Priestly表示,像TPU以及亚马逊网络服务的Trainium和Inferentia芯片(仅举两例)这样的定制AI加速器在2023年只推动了4亿美元的收入,到2028年也只能推动42亿美元的收入。

如果人工智能芯片的价值占计算引擎价值的一半,而计算引擎的价值占系统成本的一半,那么这些相对较小的数字加起来,就可以从数据中心的人工智能系统中获得相当大的收入。

现在,让我们来看看IDC是如何看待人工智能半导体和人工智能服务器市场的。该公司几周前发布了这张有趣的图表。

在这张图表中,IDC将CPU、GPU、FPGA、定制ASIC、模拟设备、内存和其他用于数据中心和边缘环境的芯片的所有收入汇总在一起。然后,再剔除计算、存储、交换机和其他设备的收入,因为这些设备适用于人工智能训练和人工智能推理系统。这不是所有系统的价值,而是系统中所有芯片的价值;因此不包括机箱、电源、冷却、主板、立卡、机架、系统软件等。如图所示,该图表包含2022年的实际数据,并仍在估算2023年至2027年的数据。

在IDC的这份分析中,半导体的人工智能部分从2022年的421亿美元增长到2023年的预计691亿美元,2022年到2023年的增长率为64.1%。IDC认为,今年的人工智能芯片收入(这并不仅仅指XPU的销售额,而是指数据中心和边缘的人工智能系统中的所有芯片内容)将增长70%,达到1,175亿美元。如果计算2022年至2027年的数字,IDC预计数据中心和AI系统中的AI芯片内容的总收入将以28.9%的年复合增长率增长,到2027年达到1933亿美元。

该图表的博文发表于5月底,是基于2月份的一份报告。在那篇文章中,IDC添加了一些服务器收入的数字,将人工智能服务器与用于其他工作负载的服务器区分开来。

IDC预计,2023年全球服务器销量将下降19.4%,仅略低于1200万台,但由于人工智能服务器的平均售价非常高,人工智能服务器的收入(基于去年对2022年人工智能服务器收入98亿美元的估计)增长了3.2倍,达到313亿美元,占市场份额的23%。IDC预计,到2027年,AI服务器将带动491亿美元的销售额。IDC没有透露其对2027年服务器收入的最新预测,但正如这里所显示的那样,截至2023年底,这一数字为1891.4亿美元。

顺便提一下,在IDC划分服务器市场时,使用CPU上的原生矩阵或矢量引擎在CPU上进行人工智能运算的机器不被视为加速型,无论如何,笔者认为对2027年人工智能服务器收入的预测过低,或者对2027年整体服务器收入的预测过高,或者两者兼而有之。到2027年,具有某种加速功能的人工智能服务器的收入占比或将略低于一半,而且笔者假设数据中心将出现大量的加速和生成式人工智能。