本文来自半导体产业纵横,作者/一宝。

可以确定的是,云计算、AI等前沿技术的深度参与,给芯片设计的高墙壁垒撕开了一个口,带来了生机。

中国工程院院士、计算机专家李国杰公开提出,EDA软件发展的新趋势有三个:一是智能化EDA,本质上是在给定约束条件下寻求最优IC设计方案,最终目标是实现“全自动化”。“就像是自动驾驶一样,最终也要实现无人的自动设计。”二是开源EDA,形成开放的工具集群和行业生态,由系统厂商、芯片厂商和EDA厂商共同制定开放标准,大幅度降低专业人员门槛。三是高算力的EDA,即EDA与云计算相结合,在“云上”提供EDA服务。

早在2021年6月,谷歌研究院和美国斯坦福大学提出了一个深度强化学习方法用于芯片平面规划。相关论文以题为“A graph placement methodology for fast chip design(一个快速芯片设计的布图布局方法)”发表在Nature上。这是EDA与AI相结合影响最深的学术论文,本次联发科的新设计方法是否真的可以超越谷歌的算法,将在7月大会见到分晓。

就在上月,联发科宣布携手台大电资学院及至达科技的研究成果入选了EDA工具设计自动化会议(DAC)。论文中提出多目标强化学习的芯片摆置设计法,超越Google之前于Nature期刊发布的算法,更适用于多目标如功耗、性能和面积的芯片设计优化,能够在降低开发成本、缩短开发时间、提升芯片性能等方面发挥重大效用,该技术已商用在联发科技移动通信的天玑系列,也会广泛运用在其他产品线上。

但是,无论企业间如何互相颠覆技术,AI可以帮芯片设计提高效率和准确性的论断已经毋庸置疑。而作为中小企业芯片设计的主要难题,云计算又给了成本以答案。

EDA全面进阶,AI作旗手

芯片敏捷设计是未来发展的一个主要方向,深度学习等算法能够提高EDA软件的自主程度,提高IC设计效率,缩短芯片研发周期。机器学习在EDA的应用可以分为四个方面:数据快速提取模型;布局中的热点检测;布局和线路;电路仿真模型。

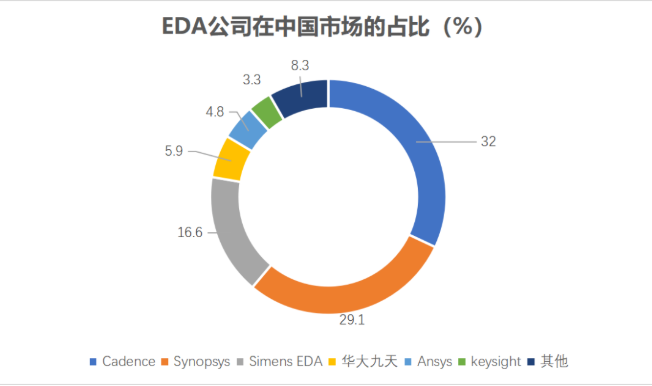

长期以来,EDA市场被国外公司垄断,EDA的国产化率仅10%左右,面对巨头过去二三十年里构筑的技术和商业壁垒,实现突破挑战非常大。而在AI与EDA的进阶结合中,国外巨头仍然当仁不让。

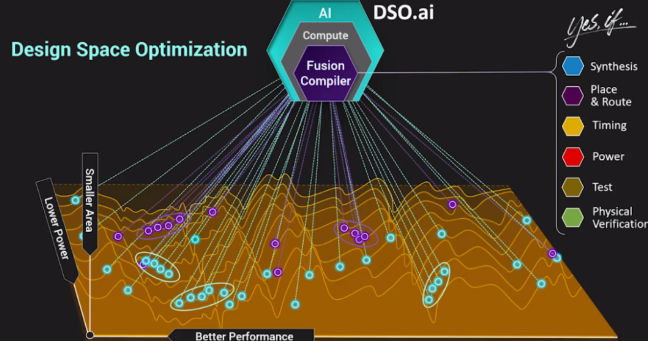

2020年,新思科技发布DSO.ai(Design Space Optimization AI)软件,这是业界第一个机器学习进行芯片设计的商业方案,它可以让IC设计工程师更自主地确定在芯片上排列布局的最佳方式以减少芯片面积和降低功耗,也是新思在EDA上使用AI的开端。

来源:新思DSO.ai发布会

利用强化学习,DSO.ai可以根据设计目标来评估数十亿个替代方案,并快速产生明显优于优秀工程师的设计方案。DSO.ai能够解决的问题/方案的潜力是巨大的:在芯片上排放各种组件的可能方案数量大约有10的9万次方个。DSO.ai的试验结果表明,它提高了18%的工作频率,而且降低了21%的功耗,同时将工程时间从六个月缩短到一个月。

三星已经与新思科技合作,将AI技术融入到芯片的设计中。三星电子在2021年公开表示,其通过AI技术找到了一个系统化的最优解决方案,超越了此前可以达到的芯片PPA(功率、性能和面积)效果。

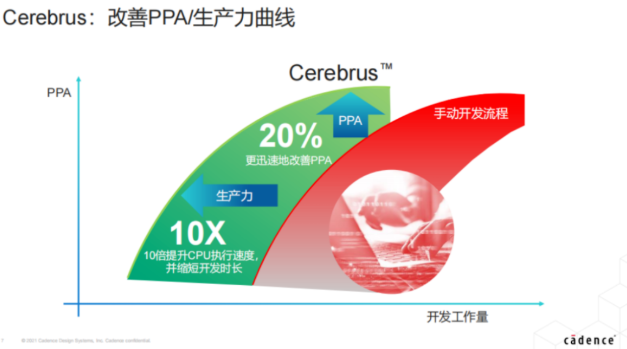

2021年,Cadence也发布了Cerebrus技术。Cerebrus直接集成到了Cadence工具链,可以工作在芯片设计的任何阶段,从System C定义到标准库单元、宏、RTL以及signOff,它允许一个工程师给它以任何级别上定义的规范和优化对象。自动化floorplan允许工程师指定常规PPA之外的优化点,如线长、线延迟、电网分布、IR drop、IO相对于物理芯片边界的位置等。

Cadence的Cerebrus工具使用强化机器学习来优化流程,并与芯片设计一起使用。Cadence表示机器学习workflow可以从一个未经训练的模型开始,在50–200次的迭代中找到最优点;如果可以重用一个组织模型或遵循一些约束可以进一步减少优化时间。从理论上讲,一个组织可以建立一个预先训练过的模型库,使Cerebrus能够为任务尝试最好的模型,如果失败了将重新开始,但仍然会得到很好的结果。

就其客户而言,瑞萨电子在12nm高速CPU设计项目中应用了Cerebrus,进行物理实现流程和布局规划的优化。三星同样也与Cadence展开了合作,在5纳米手机CPU实验中,Cerebrus工具帮助一个工程师在10天内实现了3.5 GHz的手机CPU,同时还节省了泄漏功率、总功率,并提高了晶体管密度。与几个月来使用近12名工程师的预测时间线相比,Cerebrus实现频率增益为+420 MHz,节省了26mW的泄漏功率和62mw的总功率。

Mentor将AI用于芯片设计的已经有了几套工具:lHLS高阶综合可以把生产效率提高近两倍,验证成本下降了80%。lOPC技术可以用于半导体生产制造,在7nm基础上需要4000个CPU运行一天才能生产出1个Mask,但如果使用Mentor的机器学习算法,就能够将运行时间下降3-4倍。

除了EDA的专业公司之外,谷歌和英伟达凭借自己的技术基础也在芯片设计上做了相当的研究。谷歌人工智能的负责人Jeff Dean在2020年国际固态电路会议(ISSCC)等场合介绍了谷歌基于机器学习开发的用于芯片设计的布局布线模型,并通过在其自研处理器上的应用,证实了效率和布线结果优于人类,这给半导体界注入一针强心剂。

云计算为数字底座,将EDA的想法做成现实

随着IC设计复杂度的不断提升,EDA软件作为IC设计公司赖以生存的工具也给IC设计公司带来了一些压力。

芯片设计业务本身对于算力的需求都不是恒定变化的,而是呈现出一条波动性很强的曲线,尤其是投片前3个月,对算力的需求是“无限”的。面对这种波动性很强的业务需求,IT团队很难通过自购设备来满足。若是买多了,可能会出现设备闲置,若是买少了,可能算力又不能完全满足,不管是哪一种,都是成本在无谓消耗。

计算资源需求激增、EDA峰值性能需求难以被满足,深工艺数据迁移的消耗成本,多项目并行发生的资源抢夺以及办公地点限制带来的效率影响等,这些问题都会直接影响芯片的研发周期以及研发成本。

IC设计上云能平滑多项目并行带来的资源抢夺问题,降低EDA的购买成本,进而提升研发整体的效率。

此前,新思科技宣布亚马逊公司旗下的云计算服务平台部署了新思科技的VCS FGP技术。在云端运行相关技术,可让设计团队实现更高的效率,缩短验证收敛时间,获得优异的硬件性价比。许伟表示:“EDA上云是一个发展趋势,不管是算力还是大数据等云计算端都有着自身的优势,将有越来越多设计公司从自建私有云向公有云过渡。”

云技术的运算能力与储存容量与EDA技术融合,可以在很大程度上解决当前IC设计面临的算力缺口,为开发者提供实时可用的算力、更加灵活高效的开发环境、更加优化的成本,并缩短产品上市时间。

作为产业多方共同成就“云中EDA”的典型案例,Microsoft Azure和Mentor及台积电在10小时内验证了AMD EPYC上的大尺寸Radeon Instinct Vega20集成电路设计。AMD这款芯片设计中有132亿颗晶体管数量惊人,通过在Microsoft Azure云平台上运行台积电认证的7nm Mentor Calibre设计套件,AMD在19个小时内完成了两次验证,大幅缩短了物理验证的总周转时间。此外,AMD还将Calibre nmDRC扩展到69个HB虚拟机上的4140个内核,使工程师能够平衡紧迫的时间与苛刻的成本。

微软Azure用于EDA的解决方案客户。来源:微软

芯片设计可以全部交给机器?

未来可以,但是现在不行,甚至我们还有很长的路要走。一直以来,AI饱受争议。Cadence表示,或许Cerebrus能解决80%的问题,但剩下20%的工作仍需要人来完成,而这个二八分的比例已经是非常难得。新思科技人工智能实验室主任廖仁亿所说,人工智能是EDA未来的终极形式。既然是终极形式,那就意味着当前阶段还没有完善和成熟,还不具备取代人类的能力。

而说到EDA上云,相比于PCB设计工具上云,EDA上云发展速度明显较慢。业内专家表示,这一方面是由于一些公司对于云的安全性还是存疑,将其专有IP放到云中会感到担忧;另一方面,目前私有服务器中心对于大多数设计来说其实已经足够。

由于芯片设计相关文件是公司的知识产权,在许多情况下,它们可以说是公司最有价值的财产。考虑到这一点,公司历来将其所有EDA和其他设计文件专门托管在本地机器上,任何人都无法在其网络之外访问。云计算本质上不如本地计算安全。迁移到云端,就意味着公司将信任其他实体,来托管可能价值数十亿美元的知识产权。此外,托管上云可以允许成千上万的用户同时访问相同的硬件资源。此功能可能会增加信息被恶意对手窃取或黑客攻击的风险。公司如果能放心地将他们的设计迁移到云中,则一定需要云资源已经验证过端到端的安全性。

虽然面临技术上和商业上的困难,但是AI+EDA上云解决方案的创新是向好的,也是至关重要的。随着越来越多的商业实践和需求倒逼,这将逐渐走向现实、走向合适。