本文来自钛媒体(www.tmtpost.com),作者 | 极智GeeTech。

在1927年上映的《大都会》中,全世界第一部包含人形机器人的角色Maria诞生。

时隔60多年,人形机器人从电影走向现实。2000年,本田的ASIMO成为世界上最著名的人形机器人之一,它能够行走、跑步甚至进行简单的交流。如今,人形机器人浪潮正全面席卷而来。

2024年,在大模型的加持下,一个足够性感的故事正在展开:长出“大脑”的人形机器人与科幻电影中通用机器人之间的差距正在缩短。在今年世界机器人大会上,27款人形机器人齐聚亮相,创历届之最。

作为人形机器人的内核,具身智能站在大模型和自动驾驶的臂膀上,其商业化进程要比预期来得更快。故事的书写者们,已在具身智能领域内掀起一场诸神之战。

具身智能vs自动驾驶

对于具身智能,并没有一个严格的官方定义,其通常是指本体与智能体的结合,本体实现与物理环境的交互,感知环境做出行动,智能体通过环境信息持续学习赋予智慧,是包含人工智能、机器人本体、认知科学、神经科学等多学科交叉的系统。

2024年5月,英国自动驾驶独角兽Wayve完成了10.5亿美元C轮融资,这不仅是英国史上最大规模的AI融资,也是迄今为止全球排名前20名的AI融资之一。值得注意的是,Wayve联合创始人兼CEO在完成融资当天写下这样一句话:“具身智能注定会成为最具价值的AI应用,未来还可能会改变我们与科技的交互方式。”

令人好奇的是,为什么一家自动驾驶公司要在融资当天提到具身智能,甚至还极为看好?

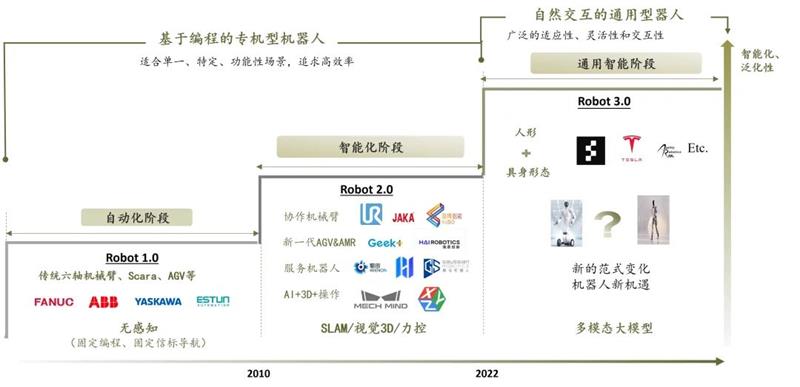

有人说,自动驾驶的存在是取代司机,具身智能的存在是要替代整个人类。当然,这只是跟随如今互联网风格的一种狭隘理解。自动驾驶与具身智能的真正相似之处是,从技术到底层逻辑的相似。而一种更好的理解则是,既然2024是自动驾驶的商业化元年,那么同样地,它也见证了具身智能的“元年”。

根据全球顶级对冲基金Coatue发布的一篇关于“具身智能”的报告《The Path to General-Purpose Robots》(通往通用机器人之路),如果将具身智能的阶段与自动驾驶的阶段做类比,“过去无人驾驶汽车从L1到L2花了大约20年,而从L2到现在的L4只用了不到10年;那么人型机器人从L1到L2用了大约50年,从L2到L4预计只需要不到5年。”

业界普遍认为,人形是机器人领域形态发展的最终目标,如果用自动驾驶的等级类比,即拥有高智能水平的人形机器人是L4。

与智能汽车类似,具身智能的实现包括“感知、决策、控制”三个主要环节,并需要内外部通信传输的支持。

感知是具身智能交互世界的窗口,首先要通过环境传感器、运动传感器收集环境与自身状态信息,作为决策环节的依据;其次,要根据感知的信息以及任务目标,对自身行为进行规划决策,并向控制模块发出指令;之后,将决策指令转化为实际操作,实现与物理世界的互动;传输方面则强调低时延、多连接、连续性能力。

从商业化的角度来看,具身智能与自动驾驶的发展路径也或有高度拟合。以L2、L4区分,具身智能时代的人形机器人可以分为2种路径:一种是在L2级别下逐步孵化出衍生的商业化产品,并且机器人的躯体形态也逐渐从轮式、足式、双臂、到全身等等;而另一种则是L4级的打法,企业从一开始就只做人形机器人,直接求解最难的问题。通过大规模融资来穿越技术的发展周期。

自动驾驶的商业化有三类机会:首先是车本身,即L4自动驾驶技术的机会;其次是应用场景,即L2级别自动驾驶的机遇;最后是传感器、毫米波、智能座舱等供应链技术。

清华大学智能产业研究院(AIR)院长张亚勤认为,无人驾驶将是未来五年内最大的物理(具身)智能应用,并且有望成为第一个通过“新图灵测试”的具身智能系统。2025年将成为无人驾驶的“ChatGPT时刻”,2030年无人驾驶成为主流,预计有10%的新车具备L4级别的自动驾驶能力。

对具身智能来说,机器人从局部到全身整体的蜕变过程,也会带来三类机遇。

首先是机器人本体的开发,企业若有条件在初期就推出人形,自然能抢夺市场先机,让后来者很难分一杯羹。

其次是场景机会,目前机器人的应用场景相对较少,但这也为行业提供了探索和发展的空间。

第三是产业上下游的机遇,上游包括智算中心的建设、算力和端侧模型等赋能机器人的关键技术;下游则涉及到各种传感器、关节模组,它们相当于机器人的感官系统,包括视觉、触觉和运动感知等等。

很显然,在具身智能中,“上难度”的人形机器人代表着需要穿越周期的L4,甚至是L5。

“大脑+小脑”,大模型实现具身智能

从马斯克到AI知名学者李飞飞,从英伟达、OpenAI甚至到国内几乎所有科技大厂,全部纷纷涌入具身智能赛道,一致看好这个如今AI大模型加持下的机器人产业。

今年,人形机器人行业在具身智能领域取得了显著的突破,基于通用大模型、数据集、高效计算架构、多模态融合感知等关键技术,为人形机器人安上聪明的“大脑”,使得人形机器人具备认知和决策能力,推动人形机器人走向实用阶段。

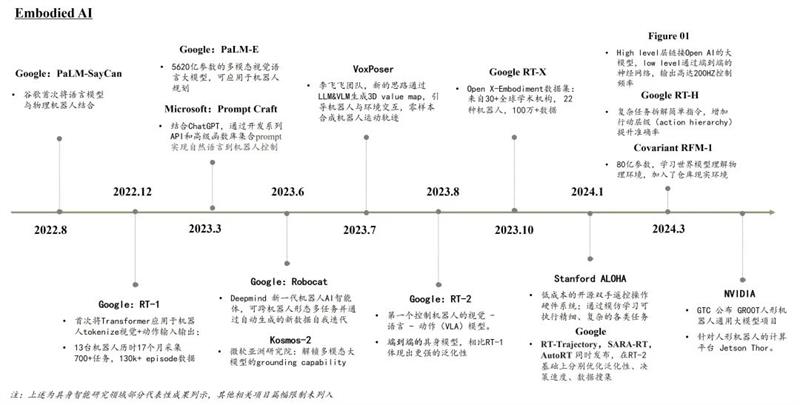

从大模型角度看,从最初的大语言模型(LLM),逐步迈向图像-语言模型(VLM)乃至图像-语言-动作多模态模型(VLA),这一转变不仅意味着机器人将拥有更加丰富的信息处理能力,更预示着它们将能够跨越语言与视觉的界限,实现更为复杂、灵活的交互方式。在这样的技术背景下,人形机器人正朝着具身智能的终极目标迈进。

“具身”特点使具身智能大模型与通用大模型存在显著差异。传统具身智能的研究以深度学习范式为主流,通过模仿学习或强化学习技术训练具身系统,使其习得技能。但传统深度学习算法对数据集的依赖程度较高、迁移泛化能力较弱,对于训练数据以外的技能执行起来较为困难。

大模型的出现为迈向通用人工智能提供契机。自谷歌Transformer神经网络架构发布以来,众多研究者发现基于Transformer的预训练语言模型在非语言类的任务中也能取得不错的效果,具有较强的泛化能力。此后大模型被引入具身智能领域,例如谷歌在2023年发布的PaLM-E模型,即是基于Transformer神经网络开发的具身多模态大语言模型。

相较通用大模型,具身智能大模型需要更多地考虑感知的细度与广度、与环境的交互性以及控制的协调性。

具身智能系统不仅要能够准确地识别物体的类别和属性,还要将视觉信息转化为精确的空间坐标,以供机械臂、灵巧手等部位执行精细操作和关节控制。

同时,除文本、图像、音频、视频等较为常见的模态数据外,具身智能还需要接收触觉(如力的反馈、表面材质)、姿态(如空间坐标、位移距离、旋转角度)等信息,以实现对环境更全面和准确的理解。

具身智能算法也需要理解物体的运动轨迹、事件的发展顺序,才能做出及时而准确的决策。

环境交互是具身智能区别于其他有实体机器人的重要特征,通过与环境的交互,持续学习并更新知识,从而不断提升算法性能。

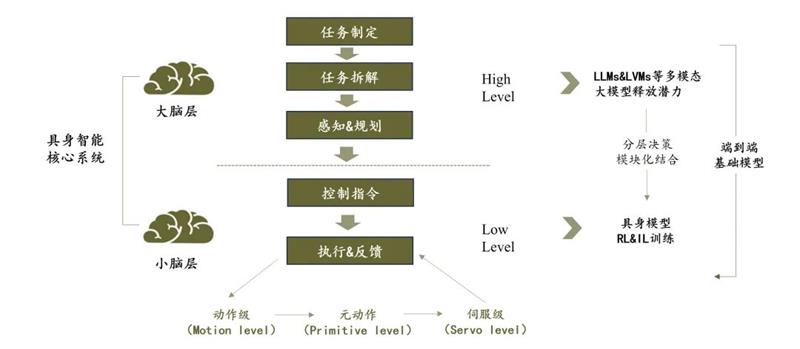

目前,人形机器人厂商主要采用分层端到端的方案,即通过“大脑大模型”和“小脑大模型”互相配合完成任务。

“大脑大模型”大多基于多模态通用大模型,完成对任务的感知规划,再通过API调度“小脑大模型”驱动关节硬件完成执行。

例如优必选人形机器人Walker S接入百度文心大模型;智元机器人与科大讯飞签署合作战略协议,依托讯飞星火大模型进行联合开发;乐聚机器人夸父搭载的是华为盘古大模型。

在“小脑大模型”方面,在技能应用上,智元机器人推出了通用的位姿估计模型UniPose、通用的抓取模型UniGrasp,通用的力控插拔模型UniPlug等一系列通用原子能力模型,可以配合大语言模型框架去做任务编排,使得机器人相比传统协作机器人更容易部署,且具备一定的泛化能力。

优必选则从应用场景出发,集合了工业场景垂域大模型技术、计算机视觉感知、语义VSLAM导航、学习型全身运动控制、多模态人机交互等人形机器人全栈式技术,将人形机器人引入汽车产线的智能搬运、质量检查和化学品操作等工位,推动人形机器人在汽车工厂的大规模应用。

值得注意的是,特斯拉Optimus使用完全端到端的神经网络大模型,借助传感器和计算机视觉技术,利用海量数据不断优化训练过程,直接生成关节控制序列。

在“小脑”操作大模型领域,各大厂商刚刚起步,多技术路径同步发展。操作大模型决定了人形机器人在任务执行侧的准确度,是大规模商业应用场景落地的前提。

数据成为第一大瓶颈

业内普遍认为,缺乏规模庞大且高质量数据是具身智能的发展难题之一。由于训练机器人所需的物理数据不如文本数据量大且易获得,相较于图文大模型千亿规模的数据训练量,目前机器人数据集量远不能满足机器人达到通用大模型的需求。

目前,解决人形机器人训练数据短缺的问题,一方面通过强化学习算法提高模型训练效率,一方面则通过仿真平台合成数据,建立数据开放生态。

数据对于训练人形机器人具有至关重要的作用,它直接影响到机器人的感知能力、思考和决策能力以及行动执行能力。大模型通过大量数据学习,让机器人理解任务意图,并迁移到下游任务中,高质量训练数据能够有效提升人形机器人场景泛化能力。

在解决高质量具身智能数据不足的问题上,可以通过模拟环境合成数据辅助真实世界数据以丰富训练数据来源,还可以构建更大规模、更多模态的共享数据集。

使用仿真及合成数据能够降低数据收集成本并提高开发效率。合成数据的常见来源是借助大量符合现实世界物理规则的虚拟仿真场景学习技能和策略,后迁移到真实世界。与真实采集数据相比,基于仿真环境的合成数据具有采集成本低、采集速度快、可扩展性强、标注准确度高的优点。

共建高质量开源数据集,可以实现数据最大化利用。由于数据获取的高成本、长周期以及隐私安全问题,大部分具身智能研究组织和企业仅限于在某个特定环境中收集数据,数据共享的缺乏导致重复劳动和资源浪费,形成“数据孤岛”。

2023年,DeepMind与众多科研机构展开合作,构建了真实机器人开源数据集Open X-Embodiment,包含22个机器人超过100万个轨迹片段、500多项技能、16多万项任务。基于此开源数据集训练的具身智能控制基础模型RT-X,表现出在跨场景、多任务应用中超越此前基于特定场景和数据集下的技能水平。

具身智能行至爆发前夜

从1973年早稻田大学开发的世界上第一款人形机器人WABOT-1,到特斯拉的人形机器人Optimus、Figure AI的Figure 02,机器人的移动能力、操作能力、交互能力已经发生了巨大的变化,过去两年,多模态大模型的加持,让机器人借着具身智能的快速发展进入了一个新的阶段。

2023年,行业新品迭出不穷,特斯拉、Figure AI,以及宇树、智元、傅利叶等一批国产品牌集中在2023年推出首款人形机器人产品,银河通用、加速进化、星动纪元等厂商纷纷成立,促成行业新品迭出的欣欣向荣之象。

行至2024年,优必选、Apptronik、特斯拉、Figure AI等公司开始陆续与汽车主机厂展开合作,将人形机器人落地汽车制造场景,初探商业化可能。

不过,目前绝大部分具身智能公司还处于不断迭代的Demo阶段,何时能够将产品与某一场景很好地结合并商业化落地,是行业关心的重点问题。

根据中金研究院及研究部联合研究发布的《AI经济学》报告,从任务角度看,人形机器人“具身”的特点使其尤其适合力量型、灵巧型及空间移动导航等体力任务,例如上下料、维修、巡检等。同时,其“智能体”特征使其具备人的智能与情感,能够在教培辅导、服务接待、人文关怀等支持型任务中发挥作用,例如教育、讲解导引、养老助残等。

大部分行业都是由多类任务组合而成的,如果向终局去看,人形机器人有望在各个行业找到适合自身落地的应用场景。比如,服务业前台(营业部客户接待)、采矿业(物料挖掘搬运)、水电热气(电力巡检)、看护养老业(康养陪护)、装备制造业(工业制造)、医疗卫生业(手术机器人)、住宿和餐饮业(餐饮服务机器人)等等,不一而足。

可以说,人形机器人的渗透不会一蹴而就,随着技术不断成熟,人形机器人不仅能够有更自然的交互性能,实现在交互要求更高的公共服务场景以及个人家用场景中的应用,还能提升对复杂场景的应对能力,进而开启在高危、救援、多变环境下的渗透。总体趋势是由专用场景向通用场景渐次渗透,最终实现在全行业各场景的落地。

具身智能时代的机器人,最终会拥有什么样的形态?这个问题的背后,归根结底是人类创造者对机器人的想象力。而无论是怎样的想象,可预见的未来机器人或许都有类似的含义:一个在视觉、学习、决策等多维度拥有更高智能水平的机器人。

一个新的物种,正在硬件与智能的交互中诞生。