本文来自半导体行业观察,作者/ 李飞。

2023年,随着以大语言模型为代表的人工智能市场持续火爆,我们看到了人工智能成为了半导体行业的最大推动力,也见证了Nvidia惊人的销售业绩以及其市值创下新高。随着新年的到来,我们也对2024年人工智能芯片做一个展望。

市场需求:人工智能仍将继续火热

从市场需求侧来看,我们认为人工智能在2024年仍然将继续火热,这也将继续推动相关的芯片行业保持良好的态势。然而,与2023年不同的是,我们认为在2024年,人工智能市场的需求会同时从云端慢慢扩展到终端,这也将驱动相应的芯片市场发展。

首先,从云端需求来看,大语言模型仍然将是主要的增长点。同时,图像生成类模型也会保持快速增长的势头。具体来说,大语言模型仍然是各大科技公司竞相研发的核心技术,包括OpenAI,微软,谷歌,华为,阿里巴巴,百度等中外科技公司都在大力研发下一代的大语言模型,而包括中国移动等传统行业的公司也在入局大语言模型领域,同时还有大量的初创公司在依靠风险投资的支持也在大力开发大语言模型。大语言模型的百家争鸣时代才刚刚开始并且远远没有落下帷幕,在这样的群雄逐鹿的时间节点,预计对于芯片的需求也会快速增长。大语言模型的特点是需要海量的数据和训练芯片资源,而且同时由于格局尚未尘埃落定有大量的公司在研发新的模型,因此总体来说训练芯片的需求会非常大。

而随着云端人工智能交互进入多模态时代,聊天机器人已经不仅仅可以用文字回答,而且还可以完成看图说话以及图像甚至视频生成等任务,因此我们认为,图像生成类的模型,以及图像和语言结合的多模态模型也将会成为云端人工智能的一个重要增长点。

除了云端之外,我们认为终端(包括手机和智能车)也将会成为人工智能的新增长点。手机上的人工智能虽然早已不再新鲜,但是随着生成模型的成熟,我们可望看到这类模型落地手机端并赋能新的用户体验。手机端生成类模型又分为两种,一种是图像生成类模型,即以扩散模型(diffusion model)为代表的模型,这类模型可以实现高质量超分辨以及高质量修图,从而可望给用户的拍照和照片编辑带来革命性的变化。另一类应用是语言模型——与运行在云端的大语言模型(LLM)相对地,过去几个月我们看到了小语言模型(SLM)的兴起。小语言模型和大语言模型一样,都是主要用于语言的理解和生成(或者说,与人对话);小语言模型在参数量变少之后,可以更灵活地应用在一些专用的场景中(而不是像大语言模型一样试图覆盖所有场景)并且提供很高的准确性,同时还有可能运行在终端设备中。

从智能车领域,一方面随着端到端多任务大模型带来的革命性性能提升(例如BEVFormer带来的俯瞰场景识别性能提升,以及商汤在2023发布的UniAD带来的多任务性能大幅提升)会推动这类模型进一步落地并且推动芯片的需求,另一方面则是来自于语言模型人机交互这类源自于云端的人工智能应用迁移到智能车场景。

因此,我们预测,2024年将会是人工智能持续火热的一年,与2023年不同的是除了云端人工智能保持热门之外,我们预计终端应用场景也会成为新的人工智能需求增长点。

云端市场格局分析

云端人工智能芯片市场,我们预计Nvidia仍然将保持领跑地位,但是AMD等竞争者预计也将获得更多市场份额。

首先,如前所述,云端市场目前主要的需求在于大语言模型和生成式图像的训练和推理。由于这些模型对于计算资源需求非常大,而且训练任务占的比例很大,因此给相应的芯片设了一个很高的门槛。这里的门槛包括了:

-芯片算力:为了支持巨大的计算量,芯片需要有足够的计算单元,内存容量和带宽

-分布式计算支持:对于大模型来说分布式计算是必须的

-软件兼容性和生态:对于训练来说,对于模型进行反复快速迭代是一个很强的需求,因此必须有足够好的生态来支持不同的模型算符快速迭代

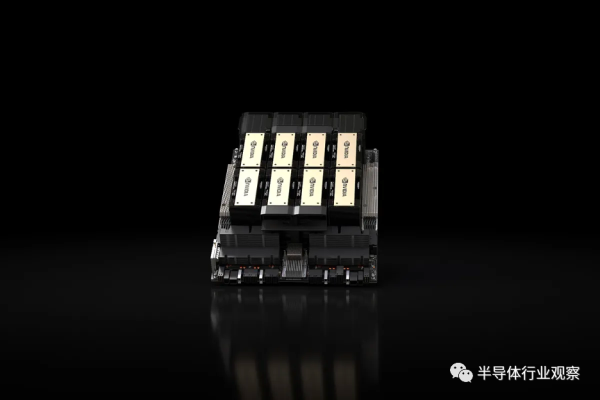

目前而言,Nvidia在这一个领域仍然是领先,无论是其芯片和分布式计算性能,还是软件生态兼容性来说,都是首选。这也是为什么2023年Nvidia的H100成为了人工智能相关公司最宝贵的资源,在市场上供不应求。在2024 H2,Nvidia将会开始出货H200,相对于H100来说,H200拥有40%和内存带宽提升以及80%的内存容量提升,因此可望会被人工智能公司争相购买。

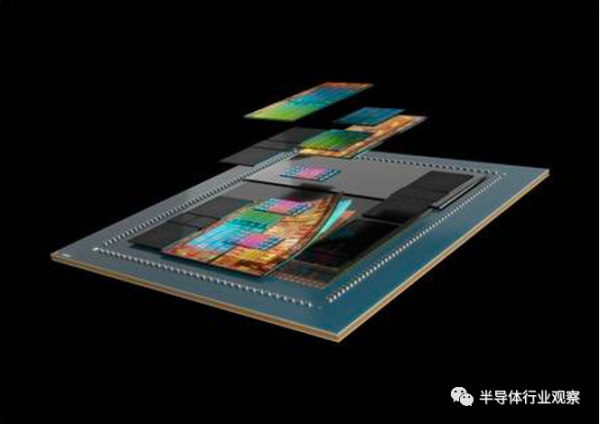

在2024年,我们预计AMD在云端人工智能领域也将更加站稳脚跟,并由此开始慢慢走向更大的市场份额。2023下半年,AMD发布了最新的MI300X用于高性能计算的GPU模组,该芯片包含大芯片粒(12个处理器/IO芯片粒),并且相比于H200来说,拥有更高(1.6倍)的FP8算力,以及更大的内存容量和带宽(1.2倍)。从AMD公布的实测数据来看,MI300X的推理能力大约比H100强20%-40%,训练性能则和H100持平。我们认为,软件生态(包括编译器性能)将成为决定AMD在云端人工智能市场能否成功的决定性因素,而这一点预计在2024年将会有所改善:OpenAI将在最新发布的Triton框架中加入对于AMD MI300X的支持,而各大初创公司的人工智能加速软件框架也在加强对于AMD GPU的支持。随着芯片性能和软件生态的提升,以及各大科技公司对于Nvidia GPU一家独大地位的担忧态度,我们预计2024年对于AMD的GPU在人工智能市场将会是重要的一年,预计将会看到更多客户的应用。

从供应链角度,由于云端人工智能芯片对于HBM3等高带宽内存有着强力的需求,我们认为HBM内存以及高级封装(如CoWoS)的产能仍然将会火热,这也将推动相应半导体企业扩大产能,以及积极研发下一代内存和高级封装技术。从这个角度看,人工智能应用仍然将会是推动半导体新技术高速发展的核心动力。

终端市场格局分析

除了云端市场外,我们预计人工智能对于终端市场也有更强的需求,这也将推动人工智能成为终端计算芯片中越来越重要的差异化元素。

在手机端,人工智能的使用频率将会进一步增强,这也会推动芯片加入更多相应的算力,并且将人工智能支持作为SoC的核心亮点。例如高通发布的Snapdragon 8 Gen 3就以“低于一秒的延迟实现图像生成任务”作为一个重要卖点,估计这样的人工智能能力将会深度集成到手机厂商的操作系统中。除了高通这样的第三方芯片公司之外,自研手机芯片的系统厂商预计也会继续加码人工智能;苹果虽然在这方面保持低调,但是预计在未来会以各种方式(加大NPU算力,或者是加大软件支持)的方法来开始赋能更多人工智能在iPhone上的新拍摄用户体验。vivo在自研ISP芯片领域已经有了数年积累,而目前生成式人工智能对于拍摄体验的提升恰好和ISP有很强的协同作用,这也是2023年8月vivo发布的v3 ISP芯片强调了生成式人工智能作为一个核心亮点。未来,预计会看到越来越多这样的芯片强调人工智能对于用户体验上的赋能作用。

在智能汽车领域,Nvidia虽然不如在云端强势,但是其Orin系列芯片仍然是各大车厂考虑的标准芯片模组。我们认为,随着人工智能大模型对于智能驾驶的赋能作用逐渐加强,无论是第三方芯片还是车厂自研的芯片都将会进一步强化对于人工智能算力的投入,同时也推动芯片性能的快速提升——最近,无论是蔚来发布新自研芯片的算力规格,还是特斯拉传出将使用TSMC 3nm作为下一代芯片的生产工艺,都在提示着我们2024年人工智能将在智能车芯片领域扮演越来越重要的角色。

哪些新技术值得关注?

除了以上讨论的芯片之外,有哪些新技术可望会为人工智能芯片领域带来新的变化?

首先,存内计算和近内存计算/处理技术可望会得到越来越多的关注。对于云端人工智能来说,内存访问开销一直是一个性能瓶颈,而随着大模型的参数量越来越大,内存访问带来的开销也越来越大。存内计算和近内存计算/处理技术的主要目的就是为了降低这样的开销,让一些计算和处理任务能够在内存中就完成。在这个领域,三星的PIM(process in memory)和PNM(process near memory)技术非常值得我们关注,而这些技术也可望会成为三星未来进一步提高自身存储器技术差异化竞争力的关键。

对于终端人工智能来说,智能汽车场景中由于对于延迟有着较强的需求,因此新技术有比较多的机会能产生影响。在云端,以GPU为代表的加速芯片都是主要基于优化吞吐量的考虑,而不是延迟,因此在智能车领域必须有新的架构设计。对于车载应用来说,数据都是以数据流的形式(而不是批量的形式)进入处理器,因此人工智能芯片必须能高速低延迟处理这些数据流。另一方面,大模型正在进入智能车应用,因此如何在低延迟的情况下支持大模型推理,将会是智能车芯片中新技术需要重点突破的方向。